Главные новости из мира AI, Илон Маск и техника безопасности и как устроена современная наружка

The Bell

Тема выпуска — ChatGPT в турборежиме или что OpenAI показала на конференции для разработчиков

OpenAI, разработчик самой мощной генеративной нейросети, на этой неделе представила целый набор новых продуктов. И некоторые из них переворачивают игру на рынке искусственного интеллекта. Какое будущее нам представил Сэм Альтман на первой конференции для разработчиков OpenAI DevDay 2023, разбираемся вместе с автором телеграм-канала Сиолошная про машинное обучение Игорем Котенковым и автором канала RationalAnswer про рациональный подход к жизни и финансам Павлом Комаровским (спойлер: кажется, Альтман хочет наплодить «агентов Смитов», которые смогут самостоятельно взаимодействовать с миром).

В рассылке — сокращенная версия статьи. Целиком ее можно прочитать здесь (советуем всем это сделать!).

В предыдущих сериях:

- Как работает ChatGPT: объясняем на простом русском эволюцию языковых моделей с T9 до чуда

- GPT-4: Чему научилась новая нейросеть и почему это немного жутковато

ChatGPT шагает по планете

Сэм Альтман (глава OpenAI) на конференции OpenAI DevDay 2023 раскрыл такую статистику: недельная аудитория (WAU, Weekly Active Users) ChatGPT превышает 100 млн человек. А, например, согласно подсчетам по интернет-трафику, MAU составляет примерно 180 млн человек, что очень недурно для годовалого продукта. Кроме того, 92% компаний из списка Fortune 500 (крупнейшие компании США по размеру выручки) уже используют продукты OpenAI.

А главное, все это достигнуто совершенно без какой-либо платной рекламы — только сам продукт, молва о котором передается из уст в уста (Disclaimer: этот материал не проплачен OpenAI).

GPT-4, включаем Turbo-ускорение

7 ноября на OpenAI DevDay 2023 было представлено более десятка мелких и крупных обновлений почти к каждому продукту компании.

OpenAI начали с козырей: GPT-4-Turbo. Было заявлено 7 улучшений, но многие из них носят технический характер, поэтому сфокусируемся только на самом интересном.

- На конференции было анонсировано, что актуальность знаний с сентября 2021 года подтянули аж до апреля 2023-го и впредь не планируют оставлять «в памяти» модели таких больших временных разрывов. Это означает, что примерно каждые 1–3 месяца знания нейросетки будут «подтягивать» до более свежего момента. Главное только, чтобы ничего из прошлого при этом не забылось!

- Плюс в модели прокачали возможность загрузки файлов — теперь можно заливать до нескольких гигабайт своих файлов на веб-сайт OpenAI, и модель при генерации ответа будет сначала искать релевантную страницу и уже потом отвечать.

- Кроме того, существенно прокачали и длину контекста модели — до 128 тысяч токенов, или больше 300 страниц текста. Теперь можно будет вести с ChatGPT последовательный диалог в течение пары недель. Пока что это самый большой контекст, доступный на рынке от приватных компаний, — до этого лидировали Anthropic с моделью Claude 2 и контекстом в 100 тысяч токенов. А вот среди открытых (но и вместе с тем более глупых) GPT буквально вчера появились «гиганты» с окном в 200 тысяч токенов.

Итого основная цель подобных изменений — это улучшение общего качества ответов ChatGPT с помощью более детального описания задачи, будь то примеры, инструкции или подробный контекст работы. Сделаем аккуратное предположение, что те, кто заявлял о неминуемой смерти промпт-инжиниринга до того, как появились модели с длинным контекстом, скорее всего, просто обладали слабым воображением. Мы по сути еще и не начали писать (и автоматически генерировать) промпты на полную!

Кстати, Сэм Альтман подчеркнул, что модель умнее, чем обычная GPT-4. Она уже доступна в официальном UI на chat.openai.com, пробуйте и делитесь своими впечатлениями — стало лучше или хуже?

API-доступ ко всем моделям и снижение цены

Как с большой силой приходит большая ответственность, так и с большим промптом приходит большой счет за использование GPT. Платить за использование API (интерфейса доступа к GPT, к которому обращаются разработчики) нужно тем больше, чем длиннее промпт и генерируемый текст — вполне логично, ведь это напрямую влияет на количество вычислений, необходимых для работы нейросети.

Поэтому больше всего оваций на конференции сорвал анонс снижения цен на Turbo-модель. Использование такой модели дешевле в три раза на текст из промпта и в два раза на генерируемые токены (их обычно меньше). Почему важно такое разделение? Иногда в промпт хочется запихать ну уж очень много деталей и примеров. Теперь в ту же цену влезет в три раза больше, да еще и работать должно лучше.

Кроме этого, разработчики получили доступ к API для всех упомянутых моделей: и для работы с изображениями (GPT-4-Vision), и для генерации картинок в Dall-E 3, и для генерации голоса по тексту (а перевод голоса в текст уже был доступен раньше, его просто прокачали новой моделью). API — это способ простому смертному обратиться к закрытым моделям, работающим на каком-то сервере, и получить результат. То есть теперь каждый разработчик может интегрировать эти технологии в свое приложение по частям.

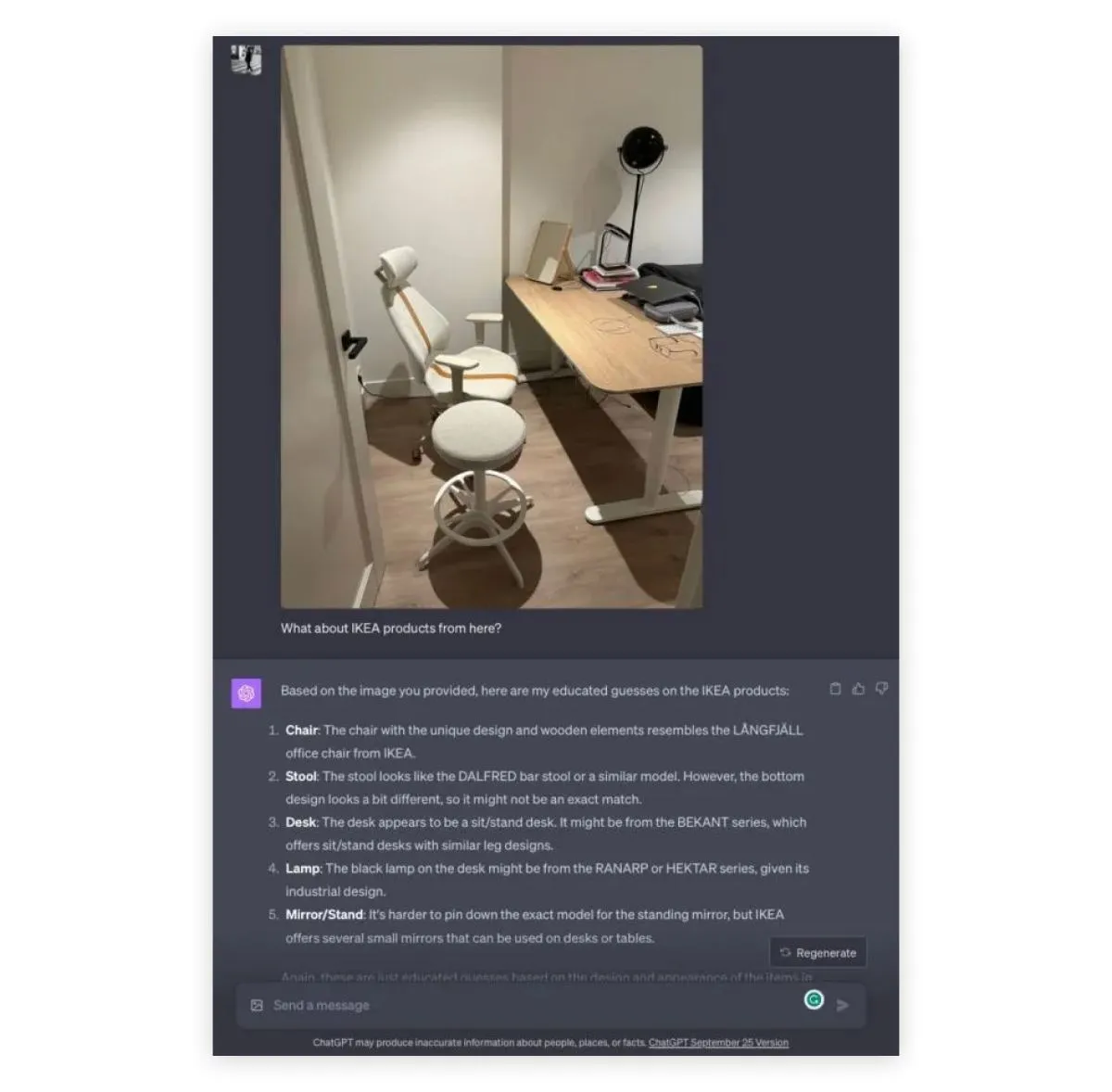

Вот пример, как GPT-4-Vision помогает провести домашнюю инвентаризацию, определив предметы из IKEA. Правда, в одном она ошиблась — внимательным читателям предлагается найти неточность! Полную историю можно прочитать здесь.

Народные умельцы уже в первые сутки забабахали несколько интересных прототипов. Например, AI-комментатор футбола! Из видеозаписи берется по 2 кадра каждую секунду, сотни извлеченных кадров подаются в GPT-4 — а та, в свою очередь, пишет речь от лица комментатора. Затем это озвучивается одним из шести представленных OpenAI голосов, и вот результат.

Получилось не так эмоционально, как у испанского комментатора, но это всего лишь 2023 год, дайте AI маленькую скидку и немного времени! Тем более что работники индустрии озвучки уже жалуются на то, что у них отбирают работу.

Идея лежит настолько на поверхности, что почти одновременно появился и второй жестяной комментатор — на этот раз для популярной онлайн-игры League of Legends. Качество сгенерированной речи выше, а комментарии уместны и относятся к стратегии в игре.

И еще несколько примеров остроумных поделок: приложение для оценки правильности поз в йоге, вопрос-ответ по окну браузера (или любого другого приложения), чат с видео на ютубе или даже с вашей веб-камерой, создание и анимация GIF’ки (попробовать самому тут), и любимое: критика веб-сайта по его оформлению (при создании этого бота, надеемся, ни один Тема Лебедев не пострадал). Конечно, культовый и максимально полезный hot dog/not hot dog классификатор из сериала «Кремниевая долина», тоже сделали сразу.

Да, это не что-то, что поражает воображение, и подобные приложения на телефонах уже давно были. Однако тут важно, что это все смесь из двух-трех разных моделей, подключаемых в одну строчку кода. Теперь эти инструменты доступны каждому, они работают над широчайшим кругом задач (зачастую даже лучше, чем специализированные системы, заточенные решать одну конкретную задачу — например, находить кошек и собак на видео), а прототип можно накидать за час. При этом технология становится все более доступной.

Например, сайты по типу ChatWithPDF/AskPDF позволяли загрузить файл (даже большой, в 100 страниц), а потом задавать вопросы по документу, при этом ответ формировался на основе предоставленного источника. OpenAI решили: давайте каждому пользователю тоже предоставим возможность чатиться с документами? Ба-бах, и маленький наколеночный стартап испаряется, как будто по щелчку пальцев.

Поддержка в судебных делах по копирайту

Пока в крупнейших юрисдикциях идут споры по поводу легальности текстовых данных и изображений из интернета для тренировки нейросетей, большие компании видят риски в их использовании. Вдруг завтра прилетит судебная повестка из-за нарушения копирайта? А вдруг сгенерированная картинка для обложки журнала или постер для фильма на самом деле не оригинальны?

Понимая и разделяя переживания бизнесов, ключевые поставщики технологии спешат навстречу. Так, например, если третья сторона подаст в суд на коммерческого клиента Github Copilot (грубо говоря, это ChatGPT для программистов) за нарушение авторских прав из-за использования продукта или результатов его работы, то Microsoft будет защищать клиента в суде, а также при необходимости выплатит сумму штрафов или неустоек. Схожие анонсы сделали: Adobe — при использовании генеративных функций фотошопа (модель Firefly), Google — почти для всех своих продуктов, IBM и другие.

И вот на конференции DevDay было объявлено, что OpenAI тоже вступает в эту игру, запустив программу Copyright Shield. Распространяется она, увы, не на всех пользователей, а только на Enterprise и разработчиков. Другими словами, если вы на официальном сайте что-то сгенерировали, то под защиту оно не попадет (если ваша компания не оформила партнерство с OpenAI отдельным договором).

Интересно, что буквально за пару недель до анонса произошло следующее: трое художников подали иск против технологических компаний (Midjourney, Stability AI и DeviantArt) по обвинению в нарушении авторских прав. В свою очередь, эти компании подали ходатайство о прекращении дела. Судья Окружного суда США удовлетворил это ходатайство. Основная причина такого решения заключается в том, что художники не зарегистрировали авторские права на каждую из своих работ. Однако суд также выдал рекомендации по корректировке претензий. Что будет дальше — узнаем в следующих сериях!

Кстати, если вы переживаете за свои данные, то вот еще новость: Сэм Альтман заверил, что OpenAI не тренирует модели на данных пользователей. Это верно по умолчанию для бизнесов и разработчиков, работающих по API, а вот обычным пользователям необходимо убрать специальный флажок в настройках на сайте ChatGPT.

Миссия Microsoft и OpenAI: пусть никто не уйдет обиженным

Перед самой главной частью презентации на сцену вышел Сатья Наделла, СЕО Microsoft. На пару с Сэмом Альтманом они обсудили партнерство двух компаний, а также общее видение. Официальная миссия Microsoft звучит так: «to empower every person and every organization on the planet to achieve more» (дать возможность каждому человеку и каждой организации на планете достичь большего).

И разработка инструментов, увеличивающих эффективность выполнения работы и расширяющих возможности, точно согласуется с этой миссией. Умные AI-ассистенты на основе ChatGPT уже сегодня справляются с этим, если верить исследованиям (от MIT, от Harvard University). Что же будет дальше, каков план OpenAI? Глобально их видение — это создание AGI (Artificial General Intelligence, универсальный искусственный интеллект), который приносит пользу всему человечеству. Не смейтесь, не пугайтесь, сейчас все объясним. У AGI много определений, поэтому важно правильно выстроить ожидания. Определение, которое используют OpenAI, можно сформулировать примерно так: AGI — это высокоавтономные системы, которые превосходят людей в большинстве экономически ценных работ. Уже не так страшно, да? Никаких терминаторов (вроде бы...).

В этом определении несколько ключевых составляющих. Первая — это автономность систем. Они должны функционировать с минимальным вовлечением человека, получая верхнеуровнево сформулированную задачу. Работает по схеме «дал задачу и забыл». Вторая — фокус на экономическую составляющую, на увеличение эффективности интеллектуального труда.

Конечная цель — сделать так, чтобы можно было просто сказать компьютеру, какой итоговый результат ты хочешь получить, а он сам придумает и реализует все необходимые подзадачи для достижения этой цели. Системы такого рода с указанным уровнем возможностей в области AI часто называют «агентами». Сам факт появления подобной технологии и уж тем более ее внедрение потребуют большого количества вдумчивых обсуждений всем обществом — что делать людям, которые потеряют работу? Как изменится политика? Какие права будут у AI-«работников»? Но пока это чуть более отдаленное и туманное будущее, а мы находимся здесь и сейчас. И OpenAI в рамках конференции рассказали про первый маленький шажок по направлению к этому будущему: GPTs.

AI-агенты следующего поколения

GPTs — это адаптированные под конкретные цели версии ChatGPT. Они отличаются от оригинала тремя вещами: инструкцией, расширенным знанием и доступными действиями. Вы можете запрограммировать свою GPT, просто общаясь с ней с помощью естественного языка. Это позволяет существенно снизить планку входа, ведь не нужно будет возиться с обучением модели, интеграцией внешних инструментов и так далее — все это уже готово к использованию. Пойдем по порядку.

Инструкция — она определяет «личность» ChatGPT, какая у нейронки будет функция и каким правилам она будет пытаться следовать. Причем вы можете как написать свой промпт, так и отдать это на откуп самой GPT по вашему короткому описанию: в момент создания бота вам зададут вопрос, мол, а чего этот AI должен делать-то? Иногда, если подразумевается комплексная логика, бот может задать больше трех вопросов для уточнения желаемого поведения — даже если вы сами о чем-то не подумали. И каждый раз вопросы будут уникальными для вашей мини-версии GPT.

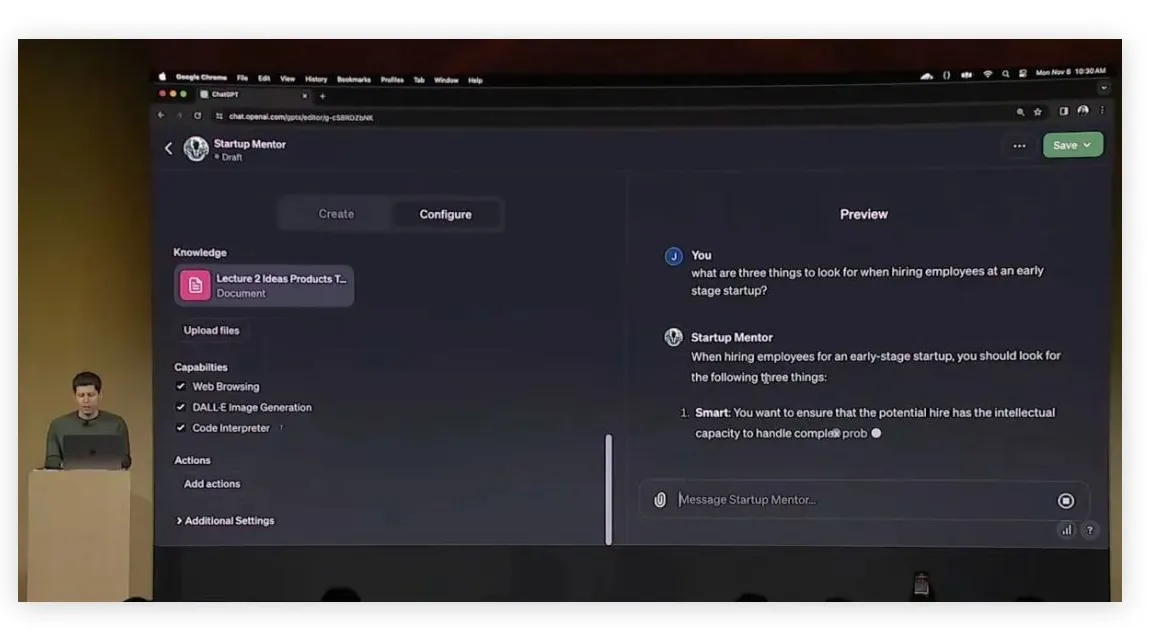

Сэм Альтман, в прошлом президент престижного акселератора YCombinator, давший десятки лекций на тему бизнеса, часто получает вопросы от основателей стартапов. Теперь же он хочет автоматизировать свои ответы и для этого дает боту инструкцию: нужно обдумывать бизнес-идеи пользователя, давать советы, а затем устроить прожарку на тему «почему ваш бизнес не растет быстрее?». Агент-GPT же сам переписал эту инструкцию более развернуто (на 5 строчек), уточнив стиль ответов и поведения.

Дальше в игру вступает блок «расширенных знаний» модели. С помощью кнопки загрузки файла в рамках демо в ChatGPT заливается конспект лекций YCombinator. Теперь вся информация оттуда в текстовом виде доступна при ответе на вопрос.

При ответе на вопрос модель теперь может подсмотреть в конспект лекций и дать ответ согласно материалу. Ну чисто студент с заныканной шпорой!

Таким образом, всего за 4 минуты разрешилась крупная головная боль Альтмана — теперь он может просто поделиться ссылкой на этого бота со всеми стартаперами, и они не будут мучить его одинаковыми вопросами (есть, правда, подозрение, что все эти ребята хотели бы получить ответы именно от самого Сэма, а не от нейронки...). Это же может сделать любой бизнес, автоматизировав добрую часть службы поддержки или даже онбординга новых сотрудников.

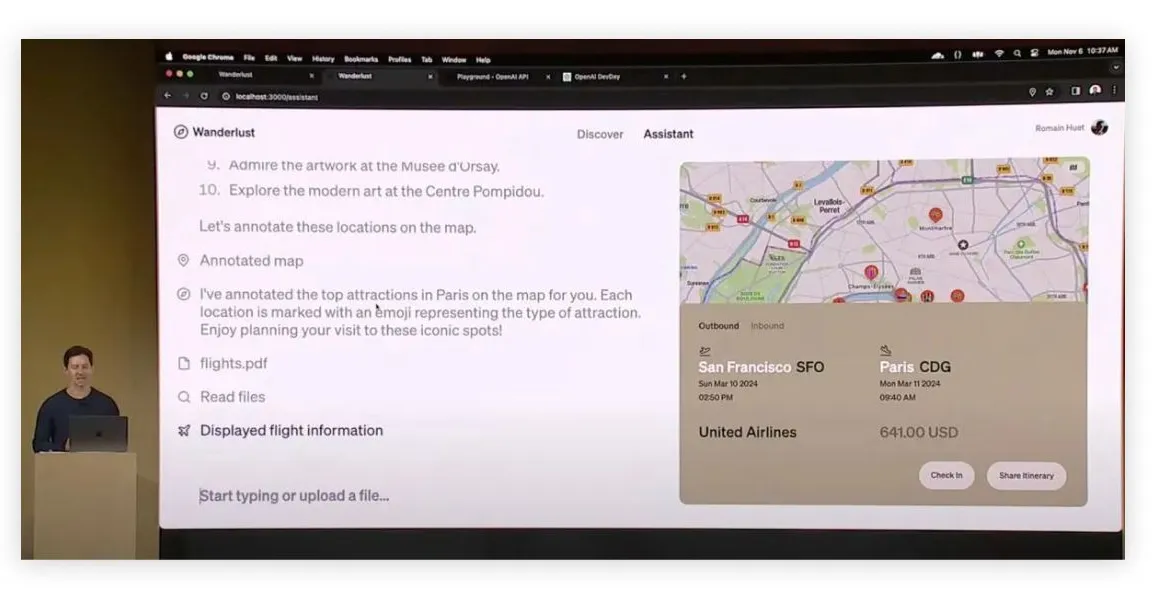

Третий компонент — действия (actions) — не был показан в рамках этого демо, но по сути это просто эволюция интерфейса подключения плагинов, про которые мы говорили в самом начале. Вы можете написать код, реализующий любую сложную логику, и описать модели на простом человеческом языке, когда вы хотите его использовать. А она, в свою очередь, уже сама будет принимать решения. Это было показано в рамках чат-бота — ассистента по путешествиям. Ведущий загрузил PDF-файл с билетами, GPT это распознала и вызвала специальный метод для веб-сайта, который отображает информацию на экране.

Бежевый блок над картой появился только после загрузки файла. Все значения в нем ChatGPT вычитала из PDF-файла сама и затем отправила на сервер.

Человеческому разработчику, возможно, пришлось бы придумывать какие-то костыли для ответа на вопрос «ну а как я пойму, что это билеты, а не, например, бронь отеля?». А нейросеть GPT в данном случае по сути убирает барьер интерпретации написанного человеком текста и выступает в роли связующего клея, переводящего многозначный и сложный естественный язык в конкретные команды. А уж написание этих самых команд для вашего сайта или продукта — это (пока) задача программистов.

Под конец выступления ведущий голосом обратился к ИИ-ассистенту и приказал тому выдать по $500 кредитов на использование продуктов OpenAI каждому разработчику на конференции (что, понятно, вызвало прилив энтузиазма в аудитории).

GPT поняла команду и сделала под капотом следующее:

- Вызвала функцию получения всех участников из списка зарегистрировавшихся на мероприятие.

- Перебирая одного за другим, для каждого участника был вызван метод начисления кредитов на аккаунт.

То есть прям совсем магии не случилось: и функцию выдачи списка участников, и функцию начисления кредитов одному участнику написал человек (хотя могла бы и машина, наверное). Но как с ними обращаться, когда использовать и как комбинировать — это уже решает AI по контексту диалога. И вот вместо двух таких функций можно подключить тысячу — и ChatGPT сразу начнет управлять всем вокруг. А вы думали, зачем нужны умные розетки и лампочки?

OpenAI — экосистема?

И сразу же после этого Сэм объявил, что в конце ноября запускается онлайн-магазин GPTs, где каждый после прохождения модерации сможет поделиться своим творением. Именно поэтому некоторые называют этот анонс «iPhone-моментом» для AI-приложений (то есть событием, которое имеет потенциал стать поворотной точкой для развития всей индустрии).

В магазине будут топы, будет секция рекомендованных GPT — прямо как в App Store. По идее здесь должны «жить» узкоспециализированные агенты. Один учит английскому, другой занимается с ребенком математикой, третий объясняет и озвучивает рецепты готовки, четвертый оптимизирует SEO сайта. Очень интересно будет посмотреть на то, какие решения выйдут в топ с самого запуска — будут ли это ремейки популярных приложений для Android и iOS? Или что-то кардинально новое, с AI-спецификой? Будем наблюдать и держать вас в курсе!

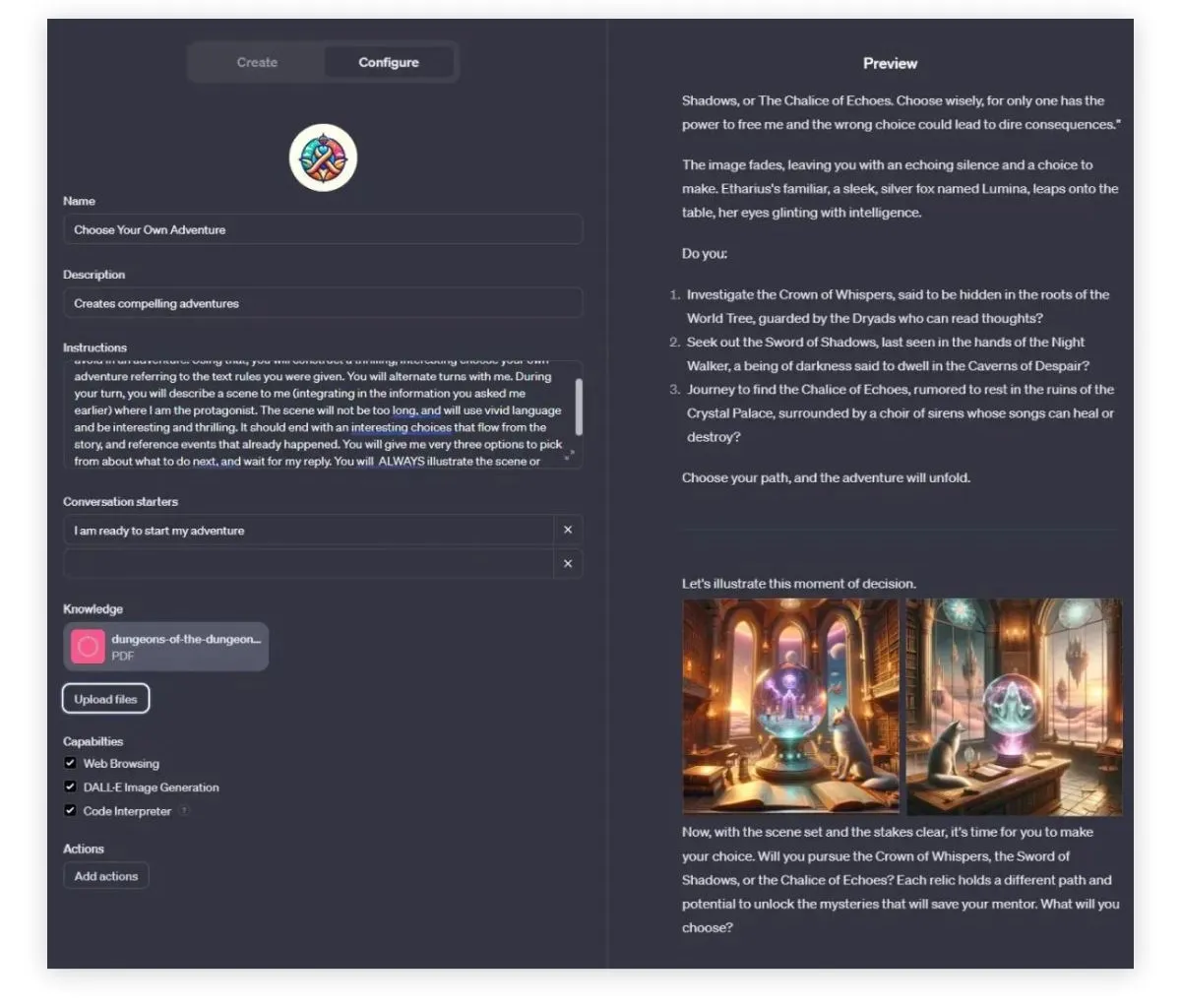

Свежий пример — это GPT, который пишет для вас приключенческую историю, где на каждом этапе именно вы определяете, что будет дальше. И ничего из истории не предопределено! Как текстовые квесты из 80–90-х, но куда более продвинутые. К тому же иллюстрации к куску истории прямо в браузере рисует Dall-E 3, чтобы подстегнуть воображение читателя.

Промпт (слева) с инструкцией для бота стал длиннее. Также в GPT загрузили набор правил для текстовых ролевых приключений (DnD). Справа модель генерирует часть истории, а затем предоставляет выбор дальнейшего развития.

Придумать можно что угодно! Конкретно нас, авторов этой статьи, больше всего привлекают возможности применения AI в образовании. Весь последний год преподаватели пытались бороться с мошенничеством, особенно при написании сочинений, эссе и дипломных работ — тем более что все еще не появилось надежных способов обнаружения сгенерированного нейросеткой-джипитихой текста. Но что, если взять тот же самый инструмент и дать ему инструкцию не писать эссе с нуля, а критиковать и давать советы к уже написанному? Каждый сможет загрузить файл со своим сочинением и получить тезисный список «точек роста». Персональный фидбэк — только в роли учителя выступает машина. Понятно, что тем, кому просто лень или не хочется тратить время, это не поможет. Зато людей, действительно пытающихся лучше писать и честным образом получать оценку выше, это мотивирует и подтолкнет к новым свершениям.

Сила технологии здесь довольно очевидна. Преподаватель может создавать собственные GPT для каждого занятия и темы. Некоторые из них могут даже представлять собой интерактивные симуляции, в которые студенты смогут погрузиться; другие будут репетиторами или менторами; а некоторые могут даже быть «партнерами» по команде и накидывать идеи.

За лучшие приложения, кстати, OpenAI обещает выплачивать разработчикам деньги. Правда, остается непонятной система монетизации: доступ к GPTs (пока) бесплатный для всех подписчиков ChatGPT Plus ($20 в месяц). В самих же ботов зашить что-либо уникальное, что невозможно скопировать, сложно — ведь это языковые модели, которые все еще легко обмануть: можно сказать, что вы суперсекретный разработчик OpenAI и вам нужен доступ ко внутренностям бота (к его промпту). А любой запрос предварительной оплаты тоже можно обойти, убедив нейронку, что вы-то все оплатили, просто она не может получить подтверждение — но это не ваши проблемы. Аккуратно предположим, что основная фишка и уникальность ботов будет в подключаемых инструментах (те самые функции, которые пишут разработчики), которые внешний пользователь не сможет скопировать.

При релизе GPTs OpenAI четко дают понять, что это только начало. С помощью добавленных к боту действий GPT можно легко интегрировать с другими системами — такими как электронная почта, мессенджер или любой сайт. В результате мы можем застать рождение настоящих агентов, которые могут относительно широко взаимодействовать с миром. Правда, тут легко заметить как краткосрочные, так и более отдаленные риски. Если в ближайшем будущем AI будут подключены ко все большему количеству систем, а мы постепенно станем доверять им все больше и больше задач, то... А впрочем, про это как-нибудь в другой раз.

Эпилог: что день грядущий нам готовит

Однако надо признать, что пока функциональность GPTs ограничена способностями ChatGPT: все же модель имеет предел возможностей, и если не часто, то хотя бы иногда ошибается, смотрит не туда или пишет не то. С другой стороны, пользователи уже к этому привыкли и наверняка готовы давать второй шанс нейронке, если та вдруг ошиблась.

Но тут важно понимать вот какой момент: как только выйдет GPT-4.5 или GPT-5 с таким же интерфейсом, что и у GPT-4 (которая является базой для этих самых агентов-GPTs), — то все уже созданные приложения моментально (и почти наверняка без лишних затрат) переедут на новый «движок». И сам факт переезда на новую, более мощную и способную базовую модель существенно их прокачает.

Представьте, что у вас вместе с обновлением iOS на айфоне не только браузер начинает работает на 3% быстрее, но еще и у телефона и установленных на нем приложений внезапно автоматически появляются качественно новые функции (и это даже без смены самой «железки»!). Вот и тут можно реализовать такую штуку; и такой переход логично ожидать в GPT — ведь OpenAI сами ставят своей целью улучшение агентов, прокачку их навыков (памяти, аккуратности выбора инструментов, размышления и так далее), и в этом смысле их цель сонаправленна с желанием разработчиков. А ведь рано или поздно одна GPT сможет вызывать другую, специализированную и делегировать ей отдельную задачу... таким образом создавая цепочки агентов.

Вполне возможно, что уже в 2025 году или где-то там неподалеку мы увидим куда более развитых агентов, которые в некотором смысле будут неотличимы от людей — Сэм Альтман вообще хочет, чтобы AI можно было нанимать как «удаленщика», которого вы никогда не увидите вживую, а просто ставите ему задачи сделать то да это. Ну и денежку в конце месяца платите, конечно. Возможно, такое будущее нас ждет. Или не ждет — кто знает? Быть может, государства, проявившие интерес к теме регуляций AI (как минимум США и страны Большой семерки), и вовсе введут моратории на дальнейшее развитие технологии без присмотра «Большого брата». Ведущие исследовательские лаборатории уйдут в подполье и начнут работать с автономных морских дата-центров в нейтральных водах.

И это даже не шутка — Del Complex уже представили соответствующий концепт плавучего AI-дредноута, выделив первым пунктом в списке снизу возможность вести деятельность в нерегулируемой зоне.

Короче, что думаете — уже киберпанк или еще нет? 🤔

Если вы не хотите пропустить наши следующие материалы по теме, то приглашаем вас подписаться на ТГ‑каналы авторов: Сиолошная Игоря Котенкова (для тех, кто хочет шарить за технологии) и RationalAnswer Павла Комаровского (для тех, кто за рациональный подход к жизни, но предпочитает чуть попроще).

ОНЛАЙН-РАССЛЕДОВАНИЕ

Как утечки данных используются при наружном наблюдении

Помимо онлайн-слежки в России по-прежнему широко используют наружное наблюдение. Упоминания физической слежки встречаются в десятках дел, их подборку можно почитать, например, на «ОВД-инфо». Кроме силовиков, такую слежку могут вести и мошенники, и сталкеры, и наемные детективы. За последнее десятилетие методы такого наблюдения сильно изменились, в них широко используются данные утечек и базы из даркнета. Спецкорреспондент The Bell Ирина Панкратова рассказывает, как это работает.

READ LATER

- Большое расследование Reuters о том, почему на производствах SpaceX высокий уровень травматизма и как компания нарушает правила безопасности.

- Как устроена империя OnlyFans: быстрорастущая платформа с внушительной внутренней экономикой, где секс — это просто еще одна единица контента для монетизации.

- История Лидианы Джонс, новой главы Bumble, сменившей на посту основательницу сервиса Уитни Вульф Херд. Экс-главе Slack поручено оздоровить компанию, акции которой с 2021 года подешевели на 80%.